Ярославский государственный технический университет

Полномочия и функции

В 1997 году закончила Вологодский государственный педагогический университет, отделение романо-германской филологии, специальность «Учитель немецкого и английского языков». С 1997 года по настоящее время работает в ЯГТУ. Стаж работы преподавателем 22 года.

С 2016 года – заведующая кафедрой иностранных языков Ярославского государственного технического университета.

Повышение квалификации:

Подготовка переводчиков в сфере профессиональной коммуникации: лингводидактический и экономико-правовой аспекты, Самара, 2018 г. в объеме 18 часов;

— Образование будущего. Московская школы управления «СКОЛКОВО», 2018 год;

— Создание комфортной интегрированной среды для обучения английскому языку. ФГБОУ ВО «Московский педагогический государственный университет», 1-2 декабря 2018 г. — 18 часов;

— дополнительная профессиональная программа (Профессиональная переподготовка) «Теория и методика преподавания русского языка как иностранного», в объеме 650 ак.

— Повышение квалификации по программе «Использование дистанционных технологий в образовательном процессе», ФГБОУ ВО «Ярославский государственный технический университет», 2019 год — 72 часа;

— Повышение квалификации по программе «Лингводидактика в неязыковом вузе: традиционные и инновационные подходы», ФГБОУ ВО «Ярославский государственный технический университет», 2019 год- 18 часов;

— Повышение квалификации по программе «Геймификация и дополненная реальность в преподавании иностранных языков», Москва, 2020 год – 72 часа;

— Повышение квалификации по программе «Лингводидактика: интегративный потенциал методики преподавания иностранного языка в вузе»: модуль 1 «LMS в преподавании иностранного языка и РКИ», ФГБОУ ВО «Ярославский государственный технический университет», 2020 год — 36 часов.

Научная работа

Научные интересы: анализ юмористическогодиалогического дискурса в немецком и английском языках, межкультурная

коммуникация, использование ресурсов Интернета при обучении иностранному языку,

механизмы формирования исторической памяти.

Публикации

Основные публикации (всего более 50 публикаций):

1) Тюкина Л.А. Индивидуальные и коллективные воспоминания как основа формирования памяти// Верхневолжский филологический вестник, Научный журнал, Ярославль, ЯГПУ, 24.12.2018, №4 (15) — стр. 179 – 185 (ВАК)

2) Тюкина Л.А. К вопросу о переводческих ошибках при обучении переводу с немецкого языка на русский в рамках программы «переводчик в сфере профессиональной коммуникации»// Сборник трудов Международной научно-практической конференции «Подготовка переводчиков в сфере профессиональной коммуникации: лингводидактический и экономико-правовой аспекты» 14-15 ноября 2018 г., Самарский государственный технический университет, Самара, стр. 145-148.

3) Тюкина Л.А., Пузенко И.Н. Информационные технологии в профессиональной деятельности переводчика// Профессионально ориентированный перевод: реальность и перспективы: сборник научных трудов / под ред. Н. Н. Гавриленко. – Москва: РУДН, 2018. – 296 с.: ил. – (Вып. 13). с. 248-255 http://gavrilenko-nn.ru/upload/pdf/35ca474406dc5efc7138d9a465743d7f.pdf

Н. Н. Гавриленко. – Москва: РУДН, 2018. – 296 с.: ил. – (Вып. 13). с. 248-255 http://gavrilenko-nn.ru/upload/pdf/35ca474406dc5efc7138d9a465743d7f.pdf

4) Тюкина Л.А. Использование сети интернет в обучении немецкому языку в неязыковом вузе (статья)// Сборник статей «Актуальные проблемы лингвистики и лингводидактики иностранного языка делового и профессионального общения»: сборник статей VIII Международной научной конференции, Москва: РУДН, 2018, 355 с. (стр. 301 — 307)

5) Тюкина Л.А. Межкультурные компетенции в обучении третьему языку «немецкий язык после английского»//Статья в журнале «Вопросы прикладной лингвистики», РУДН, 2018 Режим доступа: http://ial-journal.org/journal3132/article/intercultural-competence-teaching-third-language-german-after-english

6) Тюкина Л. А. Память и историческая память: соотношение понятий // Верхневолжский филологический вестник. 2020. № 1 (20). С. 181-187. DOI 10.20323/2499-9679-2020-1-20-181-187 (ВАК)

181-187. DOI 10.20323/2499-9679-2020-1-20-181-187 (ВАК)

7) Тюкина Л.А., Бабаян В.Н. Немецкий анекдот в структуре юмористического диалогического дискурса// Лингводидактика в неязыковом вузе: традиционные и инновационные подходы: сборник научных статей по материалам II Международной научно-практической конференции, г. Ярославль, 14-16 мая 2020 г., [Электронный ресурс]. — Ярославль: Изд-во ЯГТУ, 2020. – 327 с. – с. 26-266.

Учебные пособия (всего 7 учебных пособий):

Тюкина Л.А. Учебное пособие. Немецкий язык для студентов автомеханического факультета// Издательский Дом ЯГТУ, 2016 г. – 170 с.

Тюкина Л.А. Учебное пособие. Немецкий язык для магистрантов// Издательский Дом ЯГТУ, 2018 г. – 196 с.

ГБ №1 им. Н.А. Семашко г. Ростова-на-Дону

Оториноларингологическое отделение №2 для взрослых расположено во 2 корпусе на 1 этаже. Стационар Дневного пребывания располагается также во 2 корпусе в цокольном этаже. Отделение входит в структуру городского ЛОР центра.

Отделение входит в структуру городского ЛОР центра.

Заведующая отделением — Тюкина Маргарита Иогановна, Заслуженный врач РФ, к.м.н., врач высшей категории. Консультации: понедельник, среда, пятница с 13:00 до 15:00. Телефон 232-78-04, 250-07-28.

Старшая медицинская сестра – Полещук Елена Борисовна.

Штатная структура отделения представлена : 8 врачей, 13 медицинских сестер, 14 санитарок.

Врачи отделения:

Полях Вячеслав Джангирович – врач высшей категории.

Косинова Татьяна Владимировна – врач высшей категории.

Тюкин Юрий Владимирович – врач 1 категории.

Хейгетян Ася Саркисовна – врач 1 категории.

Цай Лилия Аркадьевна – врач 1 категории.

Шуйская Дарья Александровна – врач 2 категории.

Манукян Агавни Гургенова – врач 2 категории.

Сницарь Евгения Геннадьевна.

Отделение рассчитано на 40 коек круглосуточного стационара и 25 коек стационара дневного пребывания. В отделении имеются 14 палат: 6 –четырехместные палаты, 2 – шестиместные палаты, 6 — двухместные палаты с удобствами; перевязочная, эндоскопический кабинет, процедурный кабинет, ординаторская, кабинет заведующей отделением, кабинет старшей медицинской сестры, сестринский пост, столовая для пациентов, подсобные помещения.

Круглосуточно принимаются больные с патологией ЛОР-органов по полисам ОМС, ДМС и оказываются платные услуги.

Во 2 ЛОР отделении на самом современном уровне занимаются диагностикой, консервативным и хирургическим лечением заболеваний уха, горла и носа. Сотрудниками отделения оказывается, как экстренная медицинская помощь больным с ургентной патологией, так и плановые хирургические вмешательства, и лечение.

В настоящее время в отделении – прекрасное техническое оснащение на европейском уровне. Образование, подготовка врачей в клиниках г. Москвы, Санкт-Петербурга и известных клиниках Европы, высокий профессионализм врачей оториноларингологического отделения позволяет выполнять весь спектр диагностики, хирургических вмешательств и консервативного лечения любой патологии ЛОР-органов.

В последнее время активно развивается эндоскопическая микрохирургия носа и околоносовых пазух, позволяющая путем минимальных вмешательств избавлять человека от различных патологических состояний (полипы носа, кисты и инородные тела околоносовых пазух, искривление перегородки носа, увеличение носовых раковин при самых различных формах ринита).

Проводятся микрохирургические операции на среднем ухе (шунтирование, тимпанопластика, санирующие операции на среднем ухе).

Проводятся микрохирургические операции на среднем ухе (шунтирование, тимпанопластика, санирующие операции на среднем ухе).Наличие высококвалифицированного персонала и современного оборудования позволяет успешно осуществлять дифференциальную диагностику различных лор-заболеваний. Основным приоритетным направлением нашей деятельности являются стремление к малоинвазивным и высокотехнологичным методам лечения, что обеспечивает высокое качество оказания помощи при минимальном объеме хирургического вмешательства.

Оказание хирургической помощи базируется на использовании последних достижений в области эндоскопии и микрохирургии, что позволяет производить операции с небольшим объемом повреждения тканей. Преимуществом технологии эндоскопической микрохирургии является минимальная кровопотеря, что достигается при помощи высокотехнологичного микрохирургического инструментария, дающего возможность производить операции с минимальной травмой.

Возможно, проводить хирургические вмешательства через естественные отверстия пазух – соустья, что значительно повышает результаты лечения и значительно сокращает сроки послеоперационного пребывания в стационаре. Эндоскопическая техника используется при операциях : искривление перегородки носа, полипотомии носа, хроническом риносинусите и рините. В отделении проводится баллонная синусопластика при синуситах, что позволяет избежать хирургического вмешательства.

Возможно, проводить хирургические вмешательства через естественные отверстия пазух – соустья, что значительно повышает результаты лечения и значительно сокращает сроки послеоперационного пребывания в стационаре. Эндоскопическая техника используется при операциях : искривление перегородки носа, полипотомии носа, хроническом риносинусите и рините. В отделении проводится баллонная синусопластика при синуситах, что позволяет избежать хирургического вмешательства.Отделение оснащено современным оборудованием, позволяющим выполнять полный спектр диагностических и лечебных мероприятий. Стерилизация инструментов осуществляется на централизованной линии, в соответствии с мировыми стандартами.

• Оказание экстренной помощи при ЛОР-заболевниях.

• Хирургические вмешательства в полости носа и околоносовых пазухах, в том числе с применением эндоскопических технологий, современного инструментария (микродебридер-шейвер), эндостойка фирмы “Карл Шторц” и “Страйкер”.

• Сложные пластические операции на околоносовых пазухах при их травматическом поражении с использование имплантов ИКТ “Экофлон” для закрытия дефектов.

• Реконструктивные операции на околоносовых пазухах при сочетанной стоматологической патологии.

• Выполняются реконструктивная хирургическая коррекция наружного носа (риносептопластика при травматическом сколиозе спинки носа, седловидной деформации носа, горбе носа и т.д.) с одновременным восстановлением и коррекцией внутриносовых структур и восстановлением функции носового дыхания.

• Хирургические операции при остром и хроническом синусите, отите, мастоидите и их тяжелых внутричерепных осложнениях (менингит, тромбоз, флегмона)

• Баллонная синусоплатика как альтернативный метод хирургического лечения острых и хронических риносинуситов.

• Шунтирование барабанной полости при экссудативных средних отитах на микроскопе фирмы “Карл Цейсс”.

• Слухоулучшающие операции при нарушении целостности барабанной перепонки и слуховых косточек.

• Лечение острой и хронической тугоухости, вестибулярной дисфункции, в том числе болезни Меньера с использованием современной фармакологии и физиотерапии

• Лечения носовых кровотечения современными баллонными тампонами, методами диатермокоагуляции и хирургии

На базе отделения работает ЛОР-кафедра РостГМУ, заведующий кафедрой, профессор Заслуженный врач РФ, д.м.н. Волков Александр Григорьевич, профессор, д.м.н. Золотова Татьяна Викторовна.

Оториноларингологическое отделение находится в тесном контакте с отделениями больницы, оказывает консультативную и специализированную ЛОР помощь.

Для плановой госпитализации необходимо :

| Основные документы : | ||

| Направление на операцию из поликлиники с диагнозом | ||

| Ксерокопия полиса обязательного медицинского страхования (полис ОМС) | ||

| ||

Лабораторные исследования |

Срок действия | |

| 14 дней | |

| 3 месяца | |

| бессрочно | |

| 14 дней | |

| 14 дней | |

| 14 дней | |

| 14 дней | |

| Инструментальные и другие обследования

|

Срок действия | |

| 1 месяц | |

| 14 дней | |

| 1 год | |

| 1 месяц | |

| 1 месяц | |

| 1 месяц | |

| ||

Госпитализация больных проводится только при наличии полного перечня документов с соблюдением срока их действия (показатели обследований должны укладываться в возрастную норму).

Плановая госпитализация : Понедельник, Среда с 9:00 до 10:00

При отсутствии одного из документов, обозначенных в данных Правилах, сотрудники ЛОР-отделения оставляют за собой право в направлении пациента на дообследование.

ЗНАЧЕНИЕ ОМСКОЙ ОБЛАСТИ В РАЗВИТИИ ВНЕШНЕЭКОНОМИЧЕСКИХ СВЯЗЕЙ РОССИИ С КАЗАХСТАНОМ | Тюкина

1. Мочалин, С. М. Определение направлений транспортно- логистического взаимодействия в рамках приграничного сотрудничества России и Казахстана / С. М. Мочалин, В. А. Миляева // Логистика – Евразийский мост : материалы VIII Международ. науч.-практ. конф. –Красноярск, 2013. – Ч.1. – С. 148-155.

2. Мочалин, С. М. Пути развития региональной логической транспортно-распределитель- ной системы Омской области / С. М. Мочалин, В. А. Миляева // Ориентированные фундаментальные и прикладные исследования – основа модернизации и инновационного развития архитектурно-строительного и дорожно-транспортного комплексов России : материалы Все- рос. 65-й науч.-техн. конф. / СибАДИ. – Омск : СибАДИ, 2011. – Кн. 3. – С. 99-104.

Мочалин, С. М. Пути развития региональной логической транспортно-распределитель- ной системы Омской области / С. М. Мочалин, В. А. Миляева // Ориентированные фундаментальные и прикладные исследования – основа модернизации и инновационного развития архитектурно-строительного и дорожно-транспортного комплексов России : материалы Все- рос. 65-й науч.-техн. конф. / СибАДИ. – Омск : СибАДИ, 2011. – Кн. 3. – С. 99-104.

3. Мочалин, С. М. Подходы к транспортно-логистическому взаимодействию приграничных регионов в рамках кластеризации (на примере Омской области и приграничных регионов Казахстана) / С. М. Мочалин, В. А. Миляева // Логистика и управление цепями поставок. – 2013. – № 3. – С. 11-20.

4. Миляева, В. А. О необходимости формирования транспортно- логистического кластера в Омской области / В. А. Миляева // Развитие дорожно-транспортного комплекса и строительной инфраструктуры на основе рационального природопользования : материалы VII Всерос. науч.-практ. конф. ФГБОУ ВПО «СибАДИ» (с международным участием) / СибАДИ. – Омск : СибАДИ, 2012. – Кн. 3. – С. 66-70

науч.-практ. конф. ФГБОУ ВПО «СибАДИ» (с международным участием) / СибАДИ. – Омск : СибАДИ, 2012. – Кн. 3. – С. 66-70

5. Официальный сайт Федеральное Таможенное Управление [Электронный ресурс]. – Режим доступа http://customs.ru – (дата обращения 18.09.2016).

6. Маергойз И.М. Территориальная структура хозяйства. Новосибирск, 1986. 304 с.,

7. Краткая концепция развития Омского мультимодального транспортного узла в рамках проекта «73 МЕРИДИАН» [Электронный ресурс]. – Режим доступа: http://www. proektnoegosudarstvo.ru/materials/0007/ – (дата обращения 10.07.2017).

8. Официальный сайт Министерства развития транспортного комплекса Омской области [Электронный ресурс]. – Режим доступа http://mrtk. omskportal.ru – (дата обращения 18.09.2016).

omskportal.ru – (дата обращения 18.09.2016).

9. Указ Губернатора Омской области от 24 июня 2013 г. № 93 «Стратегия социально-экономического развития Омской области до 2025 года» [Электронный ресурс]. – Режим доступа: http://docplayer.ru/84190-Prilozhenie-k-ukazugubernatora-omskoy-oblasti-ot-24-iyunya-2013- goda-93-strategiya-socialno-ekonomicheskogorazvitiya-omskoy-oblasti-do-2025-goda.html. – (дата обращения: 13.08.2016).

10. «Обь-Иртышский бассейн: Водный путь Западной Сибири» [Электронный ресурс]. – Режим доступа: http://www.morvesti.ru/ analitics/detail.php?ID=27092 – (дата обращения 10.07.2017).

11. Мочалин С.М. Анализ материальных по- токов в рамках приграничного сотрудничества Российской Федерации и Республики Казах- стан /С.М. Мочалин, Л.В. Тюкина // Архитектурно-строительный и дорожно-транспортный комплексы: проблемы, перспективы, новации : материалы Международной научно-практической конференции, – Омск, 2016. – С.782 – 788.

– С.782 – 788.

12. Зотов Л.Л., Общий курс транспорта: учебно-методический комплекс учебное пособие / Л.Л. Зотов, А.А. Черняков, В.А. Янчеленко. – Спб.; Изд-во СЗТУ, 2012. – 90с.

13. Тюкина Л. В. Актуальность логистического подхода в приграничном сотрудничестве (на примере Омской области и Республики Казахстан) / Л.В. Тюкина // Международная научно-практическая конференция студентов, аспирантов и молодых учёных «Фундаментальные и прикладные исследования молодых ученых», – Омск, 2017. – С. 372-378.

14. Канке А.А. Основы логистики: Учебное пособие / А.А. Канке, И.П. Кошевая. М.: Кно- Рус, 2010. – 576 с.

15. «Казахстан и Россия готовы построить совместный логистический центр» [Электронный ресурс]. – Режим доступа: http://russianskz. info/economy/ – (дата обращения 19.06.2017).

– Режим доступа: http://russianskz. info/economy/ – (дата обращения 19.06.2017).

16. «Модель транспортно-логистической системы Казахстана» [Электронный ресурс]. – Режим доступа: http://logists.kz/modeltransportno-logisticheskoy-sistemi-kaz/ – (дата обращения 19.06.2017).

17. Официальный сайт Министерства транспорта Российской Федерации [Электронный ресурс]. – Режим доступа: http://www. mintrans.ru/ – (дата обращения 08.10.2016).

Страничка воспитателя Тюкиной Лидии Ивановны

| ТЮКИНА ЛИДИЯ ИВАНОВНА Квалификационная категория — Первая Общий стаж работы 35 Педагогический стаж 18 лет

|

ОБУЧЕНИЕ С ПРИМЕНЕНИЕМ ДИСТАНЦИОННЫХ ТЕХНОЛОГИЙ

Консультация для родителей «Семейный досуг зимой». Подготовила воспитатель: Тюкина Л.И. 25.01.2021 | |

Занятие для воспитанников младшего возраста по физическому развитию на тему: | |

Консультация для родителей «Как выбрать обувь для ребенка» | |

Занятие для воспитанников младшего возраста по познавательной, речевой и художественно-эстетической области развития на тему: | |

Занятие для воспитанников младшего возраста по познавательной и речевой области развития на тему: «Домашние птицы» | |

Занятия для воспитанников младшей группы по познавательному, социально-коммуникативному, речевому, художественно-эстетическому развитию на тему: | |

Занятия для воспитанников младшей группы по познавательному, социально-коммуникативному, речевому развитию на тему: Подготовила воспитатель: Тюкина Лидия Ивановна | |

Консультация для родителей Подготовила воспитатель: Тюкина Лидия Ивановна | |

Занятия по познавательному, социально-коммуникативному развитию для родителей совместно с детьми на тему: «Моя семья» Подготовила Тюкина Л.И. |

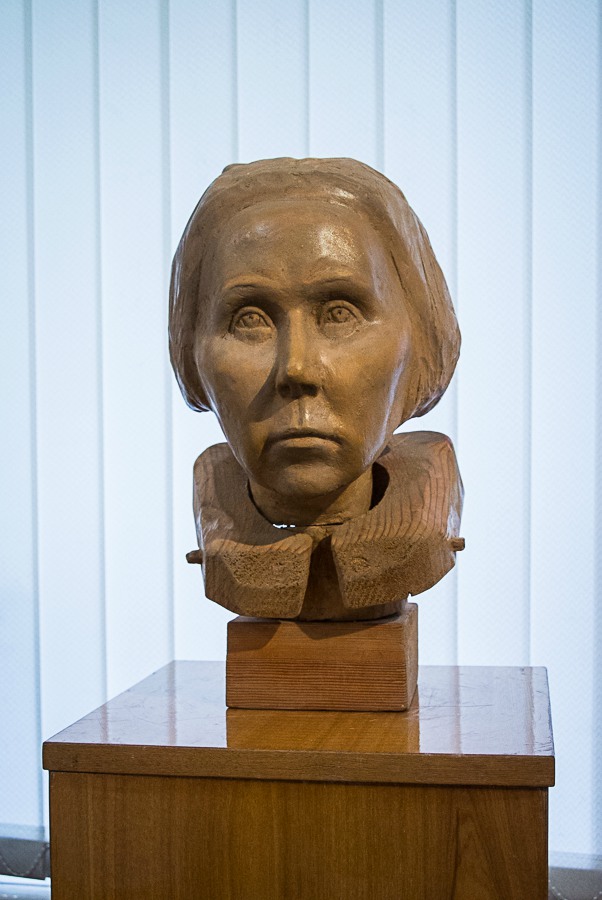

«Берега, берега…». Наталья Тюкина

Арт-галерея «Лига» приглашает на открытие выставки скульптуры и живописи Натальи Тюкиной

Берега, берега, берег этот и тот,

Между ними река – моей жизни.

Между ними река моей жизни течёт,

От рожденья течёт и до тризны.

Ю. Рыбчинский

«Берега, берега…» – эти строки дали название выставке Натальи Тюкиной, которая откроется в арт-галерее «Лига» 1 февраля. На ней будут представлены скульптуры малых форм, выполненные в разных материалах, а также станковые живописные работы.

В творчестве Натальи Тюкиной доминируют две темы – литературная и народная, каждая раскрывается автором по-своему. Поэзия всегда вдохновляла художника, и многие скульптурные работы Натальи Тюкиной посвящены поиску образов и характеров любимых классиков и современников от Пушкина до Талькова.

Тема деревни и простых людей из народа – одна из ведущих в творчестве скульптора. Старики в телогрейках и валенках, старухи в платках, ребятишки, коза… Работы, выполненные в дереве и раскрашенные темперной краской, очень характерны, в них сама соль русской жизни – нелёгкой да горькой, стойкой и терпеливой. Милая, родная, старая русская деревня, уходящая навсегда.

Православная вера хранит и спасает Святую Русь, и эта тема ярко раскрывается в творчестве Натальи Тюкиной. Многие скульптурные композиции посвящены простым христианам, святым и праведным.

Интересны и живописные работы автора. Сама Наталья Тюкина искренне признаётся: «Живопись для меня — как отдушина». Полевые цветы, белый шиповник, цветущая сирень и садовые розы, пейзажи родного края… В станковых композициях и этюдах звучат лирические нотки, передающие разные оттенки настроения.

У каждого этапа жизни – свой берег, своя пристань, и каждый человек, пытаясь найти смысл жизни, прежде всего, ищет счастья для себя, но не каждый находит. Может, в этом и есть смысл – вечно искать счастье, следуя от берега к берегу, от пристани к пристани. А может, важнее дарить это счастье другим, как делает Наталья Тюкина, открывая новые горизонты берегов и вдохновляя своим творчеством, ведь в руках настоящего мастера оживает дерево и начинает говорить камень.

Открытие выставки состоится в арт-галерее «Лига» 1 февраля в 14:00.

Экспозиция будет работать до 1 марта. Приглашаем к просмотру!

#лигаколомна

#коломенскийкремль

#художникиколомны

#кудапойтивколомне

#выставкивколомне

#Наталья_Тюкина

12-летний петербуржец Владислав Тюкин победил в шоу «Голос. Дети»

Что ВсёНочь музеевПасхаФильмы в прокатеСпектакли в театрахАвтособытияАкцииАлые парусаБалБалет, операБлаготворительностьВечеринки и дискотекиВыставкиДень городаДень ПобедыДень снятия блокадыЕвро-2021 по футболу в СПбКинопоказыКонференцииКонцертыКрасота и модаЛекции, семинары и тренингиЛитератураМероприятия в ресторанахМероприятия ВОВОбластные событияОбщественные акцииОнлайн трансляцииПраздники и мероприятияПрезентации и открытияПремииРазвлекательные шоуРазвлечения для детейреконструкцияРелигияСобытия на улицеСпектаклиСпортивные события Творческие вечераФестивалиФК ЗенитШкольные каникулыЭкологические событияЭкскурсииЯрмарки

Где ВездеАдминистрации р-новКреативные art заведенияПарки аттракционов, детские развлекательные центрыКлубы воздухоплаванияБазы, пансионаты, центры загородного отдыхаСауны и баниБарыБассейны и школы плаванияЧитальные залы и библиотекиМеста, где играть в бильярдБоулингМагазины, бутики, шоу-румы одеждыВерёвочные городки и паркиВодопады и гейзерыКомплексы и залы для выставокГей и лесби клубыГоры, скалы и высотыОтели ГостиницыДворцыДворы-колодцы, подъездыЛагеря для отдыха и развития детейПрочие места отдыха и развлеченийЗаброшки — здания, лагеря, отели и заводыВетеринарные клиники, питомники, зоогостиницыЗалы для выступлений, аренда залов для выступленийЗалы для переговоров, аренда залов для переговоровЗалы и помещения для вечеринок, аренда залов и помещений для вечеринокЗалы и помещения для мероприятий, аренда залов и помещений для мероприятийЗалы и помещения для праздников, аренда залов и помещений для праздниковЗалы и помещения для празднования дня рождения, аренда залов и помещений для празднования дня рожденияЗалы и помещения для проведения корпоративов, аренда залов и помещений для проведения корпоративовЗалы и помещения для проведения семинаров, аренда залов и помещений для проведения семинаровЗалы и помещения для тренингов, аренда залов и помещений для тренинговЗалы со сценой, аренда залов со сценойКонтактные зоопарки и парки с животнымиТуристические инфоцентрыСтудии йогиКараоке клубы и барыКартинг центрыЛедовые катки и горкиРестораны, бары, кафеКвесты в реальности для детей и взрослыхПлощадки для игры в кёрлингКиноцентры и кинотеатрыМогилы и некрополиВодное поло. байдарки, яхтинг, парусные клубыКоворкинг центрыКонференц-залы и помещения для проведения конференций, аренда конференц-залов и помещений для проведения конференцийКонные прогулки на лошадяхКрепости и замкиЛофты для вечеринок, аренда лофтов для вечеринокЛофты для дней рождения, аренда лофта для дней рожденияЛофты для праздников, аренда лофта для праздниковЛофты для свадьбы, аренда лофтов для свадьбыМагазины одежды и продуктов питанияМаяки и фортыМед клиники и поликлиникиДетские места отдыхаРазводный, вантовые, исторические мостыМузеиГосударственные музеи-заповедники (ГМЗ)Креативные и прикольные домаНочные бары и клубыПляжи, реки и озераПамятники и скульптурыПарки, сады и скверы, лесопарки и лесаПейнтбол и ЛазертагКатакомбы и подземные гротыПлощадиПлощадки для мастер-классов, аренда площадкок для мастер-классовПомещения и конференц залы для событий, конференций, тренинговЗалы для концертовПристани, причалы, порты, стоянкиПриюты и фонды помощиПрокат велосипедов и самокатовСтудии красоты и парикмахерскиеОткрытые видовые крыши и площадкиКомплексы, арены, стадионыМужской и женский стриптиз девушекЗалы и помещения для онлайн-мероприятий, аренда залов и помещений для онлайн-мероприятийШколы танцевГипер и супермаркетыДК и театрыЭкскурсионные теплоходы по Неве, Лагоде и Финскому ЗаливуТоргово-развлекательные центры, комплексы и торговые центры, бизнес центрыУниверситеты, институты, академии, колледжиФитнес центры, спортивные клубы и оздоровительные центрыПространства для фотосессий и фотосъемкиСоборы, храмы и церкви

Когда Любое времясегодня Пн, 17 маязавтра Вт, 18 маясреда, 19 маячетверг, 20 маяпятница, 21 маясуббота, 22 маявоскресенье, 23 маяпонедельник, 24 маявторник, 25 маясреда, 26 мая

Тюкина — Технология лесопильно-деревообрабатывающего производства

Тюкина Ю. П., Макарова Н. С.

Технология лесопильно-деревообрабатывающего производства: Учеб. для СПТУ. — М.: Высш, шк., 1988. — 271 с: ил.

Приведены сведения о резании древесины и дереворежущем инструменте. Рассмотрены технологический процесс и оборудование лесопильного производства; вопросы подготовки сырья, сушки и складирования пиломатериалов; технология и машины деревообрабатывающего производства; склеивание, облицовывание и сборка изделий из древесины.

© Издательство «Высшая школа», 1988

ПРЕДИСЛОВИЕ

Настоящий учебник предназначен для подготовки квалифицированных рабочих для лесной и деревообрабатывающей промышленности по специальностям: рамщик, сушильщик, контролер-браковщик, наладчик деревообрабатывающего оборудования, столяр, оператор на автоматических и полуавтоматических установках в лесопильном производстве, ножеточ, пилоточ и др.

Содержание разделов и их объемы в учебнике представлены в соответствии с действующими учебными программами для указанных специальностей по предмету «Общая технология лесопильно-деревообрабатывающего производства».

При этом рамщики, сушильщики, наладчики, ножеточи, пилоточи изучают по этому учебнику, в основном, технологию деревообрабатывающего производства, а контролеры-браковщики и операторы автоматических линий — технологию лесопильного производства и некоторые разделы технологии деревообработки.

Структура учебника и последовательность изложения материала определены в соответствии с технологической последовательностью обработки древесины в лесопильном и деревоо6ратывающем производствах. Изложение материала дано на основе последних научных разработок и рекомендаций в области технологии лесопиления и деревообработки, на базе нового отечественного оборудования, выпускаемого серийно машиностроительной промышленностью.

Каждая глава книги заканчивается вопросами по теме, что должно способствовать закреплению материала при самостоятельной работе с учебником.

Введение, § 4, 5, 10, 11. 12, 13, 14, 16, 19, 21, 22 в гл. II, гл. V и заключение написаны Ю. П. Тюкиной; гл. I, III, IV н § 6. 7, 8, 9, 15, 17, 18. 20 в гл. II и приложения — Н. С. Макаровой.

Авторы

ВВЕДЕНИЕ

Ни одна отрасль народного хозяйства не обходится без древесины. Поэтому важную роль в развитии социалистической экономики играет лесообрабатывающая отрасль промышленности.

В ее состав входят: деревообрабатывающая, целлюлозно-бумажная и лесохимическая промышленность. Из них по объему производимой валовой продукции и стоимости производственных фондов первое место занимает деревообрабатывающая промышленность.

По признакам выпускаемой продукции и технологии ее выработки деревообрабатывающая промышленность делится на следующие производства: лесопильное, слоистой клееной древесины и древесноволокнистых плит, деревообрабатывающее и специальные. В лесопильном производстве бревна и кряжи перерабатываются на пиломатериалы и заготовки. Для технологии лесопильного производства характерна механическая обработка древесины резанием.

В последнее время в технологические процессы лесопильных предприятий стали включаться операции склеивания и выработки клееных заготовок.

В производстве слоистой клееной древесины и плит бревна и кряжи перерабатываются на клееные листовые материалы (фанеру, слоистую клееную древесину и древесноволокнистые плиты). Для технологии этого производства характерны процессы гидротермической обработки, резания древесины на тонкие листы, дробления и склеивания.

Деревообрабатывающее производство в качестве сырья использует пиломатериалы, фанеру, плиты и вырабатывает готовые изделия (оконные и дверные блоки, мебель, деревянные музыкальные инструменты, спортивный инвентарь, футляры радиоприемников, телевизоров и приборов, деревянные части автомашин, вагонов).

Для технологии таких производств характерно применение столярных соединений и склеивания, механическая обработка древесины резанием и отделка древесины лакокрасочными материалами. В специальную группу деревообрабатывающих производств входят производства, выпускающие специализированную продукцию: обозное, бондарное, колодочное, стандартного домостроения (за исключением окон и дверей), лыжное, древесностружечных плит и др. Сырьем для специальных производств служат полуфабрикаты лесопильного и фанерного производства, иногда бревна и кряжи, а для изготовления древесностружечных плит ~ отходы лесопиления и деревообработки. В технологических процессах специальных производств встречаются разнообразные операции по обработке древесины: резание, гидротермическая обработка, гиутье, склеивание и др.

В настоящем учебнике рассматривается технология лесопильно-деревообрабатывающего производства. В лесопильно-деревообрабатывающей промышленности сложились следующие типы предприятий.

Специализированные лесопильные предприятия — лесозаводы. Располагаются они в пунктах концентрации пиловочного сырья. Основным видом продукции являются пиломатериалы и заготовки. Эти предприятия могут кооперироваться с целлюлозно-бумажными и гидролизными предприятиями, передавая последним сопутствующую продукцию своего производства в виде технологической щепы.

Специализированные деревообрабатывающие предприятия — мебельные фабрики, заводы по производству столярно-строительных изделий, фабрики музыкальных инструментов. Эти предприятия кооперируются с лесопильными предприятиями, получая от них пиломатериалы и заготовки. Такие предприятия располагают преимущественно в пунктах потребления продукции.

Комбинированные предприятия — комбинаты, в которых предусмотрено сочетание различных производств в одном предприятии для лучшего использования на месте древесного сырья, материалов, рабочей силы, топлива, электроэнергии, транспорта. В состав лесопильно-деревообрабатывающего комбината могут входить следующие цехи: лесопильный, мебельный, деревообрабатывающий, механического или химического использования отходов и др. Возможна комбинация лесопиления с производством целлюлозы, древесностружечных или древесноволокнистых плит, с гидролизным производством.

В последние годы в северных и восточных районах страны строятся лесопромышленные комплексные предприятия, объединяющие в своем составе лесопильно-деревообрабатывающие производства и химические производства по переработке отходов с размещением их на одной площадке и с обязательным условием полной комплексной переработки всей древесины, которая поступает в производство.

В технологии лесопильного и деревообрабатывающих производств все более широкое распространение получает агрегатный метод переработки пиловочного сырья на пиломатериалы и технологическую щепу. Внедряется технология и оборудование для пакетного метода обращения в производстве и при перевозках пилопродукции

Внутри страны и на экспорт. Появилось новое подъемно-транспортное технологическое оборудование. Во многих случаях отдельно стоящие станки заменены автоматическими и полуавтоматическими линиями и комплексами оборудования, в том числе оспащенными системами программного управления. Все это способствовало повышению производительности труда, более комплексному использованию сырья и материалов, повышению качества продукции и улучшению экономических показателей производства.

Основными направлениями экономического и социального развития СССР на 1986—1990 годы и на период до 2000 года предусматривается обеспечить развитие и интенсификацию производства в лесопромышленном комплексе страны, особенно в лесопильно-деревообрабатывающем производстве, практически без прироста объемов заготовки древесины. Основное внимание должно быть сосредоточено на бережливом отношении к сырью, рациональной и комплексной его переработке, повышении качества продукции и вовлечении в производство всех видов вторичного древесного сырья (технологической щепы, технологических опилок, стружки, коры и др.). Все эти мероприятия направлены на сохранение лесов, на охрану окружающей среды.

В текущей пятилетке опережающими темпами будут развиваться прогрессивные виды лесной и бумажной продукции. Выпуск древесноволокнистых плит увеличится на 20…23 %, картона и древесностружечных плит— примерно в 1,3 раза, целлюлозы— на 19… 22 % и бумаги—на 17…20 %. Предусматривается увеличить производство мебели на 33…35 %, улучшить ее качество и ассортимент; увеличить переработку мягколиственной древесины и довести ее до 65…70 млн. куб. метров и использование древесных отходов — до 70…75 млн. куб. метров.

Решающее условие дальнейшего развития лесной и деревообрабатывающей промышленности — повышение производительности труда, основанное на ускорении научно-технического прогресса. В текущей пятилетке производительность труда должна возрасти на 14… 16 %, а себестоимость продукции снизиться на 2…3 %. Технический прогресс должен идти в направлении создания и применения новых, более производительных и безотходных методов технологии, создания новых видов конструкций выпускаемых машин, механизмов и приборов, применения более современного производительного оборудования, в том числе роботов и станков с программным управлением, механизации производственных процессов, внедрения научной организации труда и производства.

Технология лесопильно-деревообрабатывающего производства как учебная дисциплина рассматривает наиболее рациональные способы изготовления пиломатериалов, заготовок и столярных изделий из древесных материалов с минимальными затратами сырья и труда.

Технологические процессы изготовления пиломатериалов и столярных изделий включают .механическую обработку древесины резанием, механическую сборку с помощью столярных соединений и винтов, физические процессы нагрева и сушки древесины, склеивания и отделки. Процесс отделки изделий из древесины в настоящем учебнике не рассматривается.

Глава I

ОБЩИЕ СВЕДЕНИЯ О РЕЗАНИИ ДРЕВЕСИНЫ

§ 1. ОСНОВНЫЕ ПОНЯТИЯ о РЕЗАНИИ ДРЕВЕСИНЫ

Определение процесса резания.

Механическая обработка, при которой обеспечивается получение необходимых деталей и изделии за счет изменения формы и размеров обрабатываемой древесины, осуществляется резанием, раскалыванием, давлением, дроблением.

Резание получило преимущественное применение среди других методов механической обработки древесины. Резанием древесины называется процесс, при котором разрушаются связи между частицами древесины в заданном направлении и часть обрабатываемого материала отделяется. Цель процесса — получение из древесины деталей и изделий требуемой формы, размеров и качества.

Резание может происходить с образованием стружки, в которую превращается отделяемая резцом часть древесины, и без нее (например, при делении ножницами листов шпона). Стружечное резание — один из основных методов механической обработки древесины. Другие ее методы, такие, как раскалывание и дробление, не обеспечивают заданной формы объектов обработки, поэтому применяются в основном либо на подготовительных операциях (раскалывание), либо при ударном дроблении древесины. Обработка давлением применяется редко в связи с малой пластичностью древесины.

Для резания древесины используют различные инструменты, основным элементом которых является резец в форме клина.

Геометрия резца. Под геометрией резца понимается характеристика его формы и расположения в пространстве. На рис. 1 клиновидный резец 1 отделяет от обрабатываемой заготовки 2 стружку 3 постоянной толщины ас, формируя поверхность резания 4. Толщина стружки ас обычно больше толщины а срезаемого слоя, которая измеряется расстоянием между предыду1цей и последующей поверхностями резания.

У резца можно выделить следующие основные элементы; переднюю поверхность, по которой сходит стружка; заднюю поверхность, обращенную в сторону поверхности резания 4, по которой происходит деление древесины; две боковые поверхности; главную режущую кромку, образованную пересечением передней и задней поверхностей; боковые режущие кромки, образованные пересечением передней и боковых поверхностей.

…Иван Тюкин> SPRINT

Направления и интересы

Область научных интересов Ивана включает проблемы анализа, моделирования и синтеза хрупкой, нелинейной, хаотической, метастабильной динамики; теория управления; адаптация при нестабильной динамике цели, нелинейная параметризация; оценки состояния и параметров систем ОДУ с нелинейными по параметрам правыми частями; синхронизация (стабильная и критическая), биологически вдохновленные системы обработки визуальной информации; специфические сети с пиковыми нейронами; анализ динамики моделей импульсных нейронов, их свойств и возможных функций.Совсем недавно Иван заинтересовался основами машинного обучения для задач с многомерными пространствами признаков, компьютерным зрением и интеллектуальной обработкой изображений.

Их можно охарактеризовать пятью основными темами, которые связаны друг с другом общим представлением о комплексном системном подходе к пониманию, анализу и синтезу естественных и искусственных интеллектуальных систем.

- Процессы и механизмы адаптации в сложных нелинейных системах

Системы с нелинейной параметризацией, нестабильная динамика цели, недоминантная (немажорная, мягкая, недоминирующая) адаптация - Искусственный интеллект и машинное обучение

Приложения для анализа и моделирования данных, измерения эффектов концентрации для многомерных данных, компьютерного зрения и систем безопасности - Синхронизация в нелинейных динамических системах

Глобальная, частичная, прерывистая синхронизация в ансамблях линейно и нелинейно связанных нелинейных осцилляторов.Исследование синхронизации, зависящей от подключения. Адаптивная и нестабильная, мультистабильная, переменная синхронизация - Оптимизационные алгоритмы для невыпуклых и нелинейных задач

Параметрическое оценивание суперпозиций нелинейных параметризованных функций (с приложениями к задаче обучения в многослойных перецептронах) - Нейронауки и физика нервных клеток

Принципы нейрональной обработки информации. Изучение свойств биологических клеток, анализ их функций.Структурная организация зрительной системы, система моделей для робастной и адаптивной обработки (с смоделированными неопределенностями) визуальной информации

Прочие проекты

- Математическое моделирование адаптации и принятия решений в нейронных системах

- Адаптация при нелинейной параметризации

- Неравномерные теоремы о малом усилении и сходимость к неустойчивым по Ляпунову инвариантным множествам

Ошибка 404

перейти к содержанию Перейти к навигации Мы сожалеем! Страница не найдена Отвези меня домой EHF — Дом гандбола Facebook Instagram YouTube Твиттер Linkedin [Модули.Footer.SocialLinks.TickTok_en-US] Кто мы Кто мы- EHF

- EHF Marketing GmbH

- Комиссии EHF

- EHF Федерации

- Деятельность

- Календарь

- Публикации

- EHF Anti-Doping-Unit

- ЕГФ ЕВРО

- Лига чемпионов ЕГФ

- Европейская лига EHF

- EHF Кубок Европы

- EHFTV

- Семья EHF

- Телепрограмма

- Сообщите о своей проблеме

- Конфиденциальный отчет

- Отпечаток

- Политика конфиденциальности

- Политика использования файлов cookie

- Условия и положения

Пользователь Андрей Тюкин — Stack Overflow Пользователь

Андрей Тюкин — Stack overflow на русскомСудя по всему, этот пользователь предпочитает сохранять о них загадочность.

Участник 7 лет, 9 месяцев

Ваша конфиденциальность

Нажимая «Принять все файлы cookie», вы соглашаетесь с тем, что Stack Exchange может хранить файлы cookie на вашем устройстве и раскрывать информацию в соответствии с нашей Политикой в отношении файлов cookie.

Принимать все файлы cookie Настроить параметры

границ | Передача знаний между системами искусственного интеллекта

1.Введение

Бурное развитие нейроинформатики и искусственного интеллекта (ИИ) в последние годы порождает новые фундаментальные научные и социальные проблемы. Развитие технологий, профессий, профессий и соответствующих образовательных сред для устойчивого создания постоянно растущего числа систем искусственного интеллекта в настоящее время признано одним из наиболее важных из них (Hall and Pesenti, 2017). Воспитание и рост соответствующего человеческого опыта рассматривается как способ решения этой проблемы.Однако следующим шагом является разработка технологий, с помощью которых одна или несколько систем ИИ создают среду обучения для другой, ведущую к полностью автоматизированной передаче знаний и опыта между независимыми в остальном агентами ИИ.

Передача знаний между системами искусственного интеллекта является предметом широкого обсуждения в литературе на протяжении более двух десятилетий (Gilev et al., 1991; Jacobs et al., 1991; Pratt, 1992; Schultz and Rivest, 2000; Buchtala and Sick , 2007) (см. Также подробный обзор Pan and Yang, 2010).На сегодняшний день изучено несколько технических идей для передачи знаний в области искусственного интеллекта. Использование или спасение частей системы ИИ «учителя» в ИИ «ученика» с последующей переподготовкой «ученика» было предложено и всесторонне протестировано в Yosinski et al. (2014) и Chen et al. (2015). Альтернативы утилизации AI включают сжатие модели (Bucila et al., 2006), дистилляцию знаний (Hinton et al., 2015) и привилегированную информацию (Vapnik and Izmailov, 2017). Эти подходы продемонстрировали значительный успех в улучшении возможностей ИИ по обобщению, а также в снижении вычислительных затрат (Иандола и др., 2016), в случаях передачи знаний от большего ИИ к меньшему. Однако, несмотря на то, какой из вышеперечисленных стратегий соблюдается, их вычислительная реализация, даже в случае передачи или изучения лишь нескольких новых примеров, часто требует либо значительных ресурсов, включая доступ к большим обучающим наборам и мощности, необходимой для обучения, либо доступности привилегированной информации, которая не обязательно может быть доступна конечным пользователям. Это также резко контрастирует с естественным интеллектом, поскольку недавние эмпирические данные показывают, что отдельные нейроны в человеческом мозге способны быстро обучаться новым стимулам (Ison et al., 2015). Таким образом, необходимы новые рамки и подходы.

В этом материале мы предлагаем новую структуру для автоматизированного, быстрого и неразрушающего процесса распространения знаний по системам искусственного интеллекта различной архитектуры. В этой структуре передача знаний осуществляется с помощью блоков передачи знаний, состоящих из простых линейных функционалов и / или их небольших каскадов. Основные математические идеи уходят корнями в концентрацию меры (Гиббс, 1902; Леви, 1951; Громов, 1999, 2003; Горбан, 2007) и теоремы стохастического разделения (Горбань, Тюкин, 2017, 2018), раскрывающие особые свойства случайных множеств в больших размерностях.Здесь мы обобщаем некоторые из последних результатов и показываем, как эти обобщения могут быть использованы для построения простых одноразовых алгоритмов передачи знаний между гетерогенными системами ИИ, состояние которых может быть представлено элементами линейного векторного пространства достаточно высокой размерности. После того, как знания были переданы от одного ИИ к другому, этот подход также позволяет «отучить» новые знания без необходимости хранить полную копию «ученического» ИИ, созданного до обучения. Мы ожидаем, что предлагаемая структура может проложить путь к полностью функциональному новому явлению — питомнику систем ИИ, в котором ИИ быстро учатся друг у друга, сохраняя при этом свои ранее существовавшие навыки в значительной степени нетронутыми.

Работа организована следующим образом. В разделе 2 мы представляем общую структуру для вычислительно эффективной неитеративной передачи знаний ИИ и представляем два алгоритма для передачи знаний между парой систем ИИ, в которых одна работает как учитель, а другая — как ученик. Эти результаты основаны на теоремах стохастического разделения (Горбань, Тюкин, 2017), соответствующие версии которых представлены здесь в качестве математической основы, обосновывающей подход.Раздел 3 иллюстрирует подход на примерах, а раздел 4 завершает статью.

2. Неитеративная система передачи знаний ИИ

2.1. Общие настройки

Рассмотрим две системы ИИ: ИИ ученика, обозначенный как AI s , и AI учителя, обозначенный как AI t . Эти устаревшие системы искусственного интеллекта обрабатывают некоторые входных сигналов , создают внутренних представлений входных данных и возвращают некоторые выходных сигналов .Мы также предполагаем, что некоторая релевантная информация о входе, внутренних сигналах и выходах AI s может быть объединена в общий объект x , представляющий, но не обязательно определяющий, состояние из AI с . Предполагается, что объекты x являются элементами ℝ n .

За период активности система AI s генерирует набор S объектов x .Точный состав множества S может зависеть от поставленной задачи. Например, если AI s является классификатором изображений, нас может интересовать только конкретное подмножество данных ввода-вывода AI s , относящихся к изображениям определенного известного класса. Соответствующие входы и выходы AI s , соответствующие объектам в S, затем оцениваются учителем AI t . Если выходы AI s отличаются от выходов AI t для того же входа, то в системе регистрируется ошибка.Объекты x∈S, связанные с ошибками, объединяются в множество Y. Процедура порождает два непересекающихся множества:

и

Схема, схематически представляющая процесс, показана на рисунке 1. Задача передачи знаний состоит в том, чтобы «научить» AI s так, чтобы с

a) AI s не делает таких ошибок

б) сохраняются существующие компетенции AI s по набору входов, соответствующих внутренним состояниям x∈M, и

c) передача знаний от AI t к AI s обратима в том смысле, что AI s может «отучить» новое знание, изменив при необходимости лишь часть его параметров.

Рисунок 1 . Схема передачи знаний AI. AI s создает набор своих представлений состояния, S. Представления помечены как AI t в наборе правильных ответов M и наборе ошибок Y. Учащийся Затем система AI s дополняется дополнительным «корректором», устраняющим эти ошибки.

Прежде чем приступить к предлагаемому решению указанной выше проблемы передачи знаний AI, необходимо понять основные, но фундаментальные свойства множеств Y и M.Эти свойства суммированы и проиллюстрированы нижеприведенными теоремами 1, 2 и 3.

2.2. Теоремы стохастического разделения для неитеративной передачи знаний ИИ

Пусть набор

быть i.i.d. образец из раздачи в ℝ n . Выбрать другой набор

из того же распределения наугад. Какова вероятность того, что существует линейный функционал, отделяющий Y от M, и, что наиболее важно, существует ли вычислительно простой и эффективный способ их определения?

Ниже мы приводим три теоремы о разделении кортежей k : для равнораспределения в единичном шаре B n (1) (теоремы 1 и 2) и для вероятностной меры произведения с ограниченным носителем (теорема 3) .Эти два особых случая охватывают или фактически аппроксимируют широкий спектр практически значимых ситуаций, включая, например, гауссовские распределения (асимптотически сводятся к равнораспределению в B n (1) для n достаточно больших) и векторы данных в котором каждый атрибут является числовой и независимой случайной величиной. Вычислительная сложность определения разделяющих функционалов, как указано в теоремах и их доказательствах, может быть очень низкой.Если никакой предварительной обработки не требуется, то для вывода функционалов, вытекающих из теорем 1 и 2, требуется всего лишь k = | Y | векторные сложения и, возможно, приближенное решение задачи оптимизации с ограничениями в двух измерениях. Для больших наборов данных это значительное преимущество перед машинами опорных векторов, вычислительная сложность которых в наихудшем случае составляет O (( k + M ) 3 ) (Bordes et al., 2005; Chapelle, 2007) .

Рассмотрим случай, когда лежащее в основе распределение вероятностей является равнораспределением в единичном шаре B n (1) и предположим, что M = {x1,…, xM} и Y = {xM + 1,…, xM + k} равны i.я бы. образцы из этого дистрибутива. Нас интересует определение вероятности P1 (M, Y) того, что существует линейный функционал, разделяющий M и Y. Оценка этой вероятности дается в следующей теореме.

Теорема 1 . Пусть ℳ = {x1,…, xM} и Y = {xM + 1,…, xM + k} будет i.i.d. образцы из равнораспределения в B n (1). Затем

P1 (ℳ, Y) ≥maxδ, ε1 − k (1 − ε) n− (k − 1) k2 (1 − δ2) n2 −M2∆ (ε, δ, k) n2 Δ (ε, δ, k) = 1−1k [(1 − ε) 2 − k − 11 − εδ1 + k − 11 − εδ] 2 (1) При условии: δ, ε∈ (0,1) (k − 1) δ≤ (1 − ε) 3.Если пара (δ, ε) является решением программы нелинейной оптимизации из (1), то соответствующая разделяющая гиперплоскость равна:

ℓ0 (x) = 0, ℓ0 (x) = 〈x¯‖x¯‖, x〉 −1k (1 − ε) 2 − k − 11 − εδ1 + k − 11 − εδ,Доказательство теоремы приведено в Приложении.

На рисунке 2 показано, как ведет себя оценка (1) вероятности P1 (M, Y) в зависимости от | Y | для фиксированных M и n . Как видно из этого рисунка, когда k превышает некоторое критическое значение ( k = 9 в данном конкретном случае), нижняя оценка (1) вероятности P1 (M, Y) падает.Это неудивительно, поскольку оценка (1) (A) основана на консервативных оценках, и (B) эти оценки получены только для одного класса разделяющих гиперплоскостей ℓ 0 ( x ). Кроме того, для Y не предполагалась предварительная обработка и / или кластеризация. Альтернативная оценка, позволяющая учесть возможную кластеризацию в наборе Y, представлена в теореме 2.

Рисунок 2 . Оценка (1) P1 (M, Y) как функции k для n = 2 000 и M = 10 5 .

Теорема 2 . Пусть M = {x1,…, xM} и Y = {xM + 1,…, xM + k} равны i.i.d. образцы из равнораспределения в B n (1). Пусть Yc = {xM + r1,…, xM + rm} будет подмножеством m элементов из Y , таких что

β2 (m − 1) ≤ rj, rj ≠ ri 〈xM + ri, xM + rj〉 ≤ β1 (m − 1) для всех i = 1,…, m. (2)Затем

P1 (ℳ, Yc) ≥maxε (1− (1 − ε) n) k (1 − ∆ (ε, m) n22) M Δ (ε, m) = 1−1m ((1 − ε) 2 + β2 (m − 1) 1+ (m − 1) β1) 2 (3) При условии: (1 − ε) 2 + β2 (m − 1)> 0 1+ (m − 1) β1> 0.Если пара (δ, ε) является решением программы нелинейной оптимизации из (3), то соответствующая разделяющая гиперплоскость равна:

ℓ0 (x) = 0, ℓ0 (x) = 〈y¯‖y¯‖, x〉 −1m ((1 − ε) 2 + β2 (m − 1) 1+ (m − 1) β1),Доказательство теоремы приведено в Приложении.

Примеры оценок (3) для различных настроек параметров показаны на рисунке 3. Как видно, в отсутствие допущения о попарной строго положительной корреляции β 2 = 0, поведение оценки как функция k , аналогичен (1).Однако наличие умеренной попарной положительной корреляции приводит к значительному увеличению значений P1.

Рисунок 3 . Оценка (2) P1 (M, Y) как функции k для n = 2000 и M = 10 5 . Красные звезды соответствуют β 1 = 0,5, β 2 = 0. Синие треугольники обозначают β 1 = 0,5, β 2 = 0,05, а черные кружки обозначают β 1 = 0,5, β . 2 = 0,07.

Замечание 1.Оценки (1), (3) для вероятности P1 (M, Y), которые следуют из теорем 1, 2, предполагают, что основное распределение вероятностей является равнораспределением в B n (1). Однако их можно обобщить на эквираспределения в эллипсоидах и гауссовские распределения (см. Gorban et al., 2016a, b). Более точные оценки вероятности также могут быть получены, если оценки сверху объемов соответствующих сферических крышек в доказательствах теорем 1, 2 заменить их точными значениями (см.г., Ли, 2011).

Замечание 2. Обратите внимание, что не только теоремы 1, 2 дают оценки снизу вероятности того, что два случайных i.i.d. взятые образцы из B n (1) линейно разделимы, но они также явно представляют разделяющие гиперплоскости. Последние гиперплоскости похожи на линейные дискриминанты Фишера в том, что направление различения (перпендикулярно гиперплоскости) представляет собой разницу между центроидами.

Хотя наличие явных функционалов разделения, а также пороговых значений является очевидным преимуществом с практической точки зрения, оценки, связанные с такими функционалами, не учитывают более гибкие альтернативы.Ниже мы представляем обобщение приведенных выше результатов, которое учитывает такую возможность, а также расширяет применимость подхода к выборкам из распределений продуктов. Результаты представлены в теореме 3.

Теорема 3 . Рассмотрим линейное пространство E = пролет { x j — x M +1 | j = M + 2,…, M + k }, пусть мощность | Y | = k множества Y меньше n.Рассмотрим факторное пространство ℝ n / E. Пусть Q ( x ) будет представлением x ∈ ℝ n in ℝ n / E, и пусть координаты Q ( x i ), i = 1,…, M + 1 являются независимыми случайными величинами iid взяты из распределения продукта в единичном кубе с дисперсиями σ j > σ 0 > 0, 1 ≤ j ≤ n — k + 1. Затем для

M≤ϑ3exp ((n-k + 1) σ042) -1с вероятностью p > 1 — ϑ существует линейный функционал, разделяющий Y и M.

Доказательство теоремы приведено в Приложении.

Введя теоремы 1–3, мы готовы сформулировать наши основные результаты — алгоритмы неитеративной передачи знаний ИИ.

2.3. Алгоритмы передачи знаний

Наш первый алгоритм, Алгоритм 1, рассматривает случаи, когда Вспомогательные блоки передачи знаний , т.е.е. Функциональные дополнения к существующему студенческому AI s , представляют собой отдельные линейные функционалы. Второй алгоритм, алгоритм 2, расширяет вспомогательные блоки передачи знаний до двухуровневых каскадов линейных функционалов.

Алгоритм 1 Однофункциональная передача знаний ИИ

Алгоритм 2 Двухфункциональная передача знаний ИИ

Алгоритмы состоят из двух основных этапов: этапа предварительной обработки и этапа передачи знаний.Цель этапа предварительной обработки — упорядочить и «сфокусировать» данные. Эта операция приближает настройку к той, что рассматривается в формулировках теорем 1, 2. На этапе передачи знаний создаются вспомогательные блоки передачи знаний способом, который очень похож на рассуждения, представленные в доказательствах теорем 1 и 2. В самом деле, если | Yw, i | ≪ | Sw \ Yw, i | то член (Cov (Sw \ Yw, i) + Cov (Yw, i)) — 1 близок к единичной матрице, а функционалы ℓ i являются хорошими приближениями (10).В этой ситуации можно было бы ожидать, что производительность этапа передачи знаний также будет тесно связана с соответствующими оценками (1), (3).

Замечание 3. Обратите внимание, что этап регуляризации на этапе предварительной обработки обеспечивает невырожденность матрицы Cov (Sw \ Yw, i) + Cov (Yw, i). Действительно, рассмотрим

Cov (Sw ∖ Yw, i) = 1 | Sw ∖ Yw, i | ∑x∈Sw ∖ Yw, i (x − x¯ (Sw ∖ Yw, i)) (x − x¯ (Sw ∖ Yw, i) ) T = 1 | Sw ∖ Yw, i | (∑x∈Sw ∖ Yw (x − x¯ (Sw ∖ Yw, i)) (x − x¯ (Sw ∖ Yw, i)) T + ∑x∈Yw ∖ Yw, i (x − x¯ (Sw ∖ Yw, i)) (x − x¯ (Sw ∖ Yw, i)) T).Обозначая d = x̄ (Sw \ Yw, i) -x̄ (Sw \ Yw) и переставляя сумму ниже как

∑x∈Sw ∖ Yw (x − x¯ (Sw ∖ Yw, i)) (x − x¯ (Sw ∖ Yw, i)) T = ∑x∈Sw ∖ Yw (x − x¯ (Sw ∖ Yw) + d) (x − x¯ (Sw ∖ Yw, i) + d) T = ∑x∈Sw ∖ Yw (x − x¯ (Sw ∖ Yw)) (x − x¯ (Sw ∖ Yw)) T + 2d∑x∈Sw ∖ Yw (x − x¯ (Sw ∖ Yw)) T + | Sw ∖ Yw | ddT = ∑x∈Sw ∖ Yw (x − x¯ (Sw ∖ Yw)) (x − x¯ (Sw ∖ Yw)) T + | Sw ∖ Yw | ddT, получаем, что Cov (Sw \ Yw, i) неособо, пока сумма ∑x∈Sw \ Yw (x-x̄ (Sw \ Yw)) (x-x̄ (Sw \ Yw)) T не является -единственное число.Последнее свойство, однако, гарантируется этапом регуляризации в алгоритме 1.

Замечание 4. Кластеризация на шаге 2.a может быть достигнута с помощью классических алгоритмов k -средних (Lloyd, 1982) или любого другого метода (см., Например, Duda et al., 2000), который сгруппировал бы элементы Yw в кластеры в соответствии с к пространственной близости.

Замечание 5. Вспомогательные единицы передачи знаний на шаге 2.b алгоритма 1 выводятся в соответствии со стандартным формализмом линейного дискриминанта Фишера.Однако это не обязательно, и для этой цели можно использовать другие методы, например, машины опорных векторов (Vapnik, 2000). Однако стоит упомянуть, что машины опорных векторов могут быть подвержены переобучению (Han, 2014), и их обучение часто включает итерационные процедуры, такие как последовательная квадратичная минимизация (Platt, 1999).

Кроме того, вместо множеств Yw, i, Sw \ Yw, i можно использовать несколько более агрессивное деление: Yw, i и Sw \ Yw соответственно.

В зависимости от конфигурации образцов S и Y, алгоритм 1 может иногда создавать единицы передачи знаний, ℓ i , которые слишком агрессивно «фильтруют» ошибки. То есть некоторые x∈Sw \ Yw могут случайно вызвать неотрицательный ответ ℓ i ( x ) ≥ 0, и в результате их соответствующие входы в A s можно проигнорировать или неправильно использовать. Чтобы смягчить это, можно увеличить количество кластеров и единиц передачи знаний соответственно.Это увеличит вероятность успешного разделения и, следовательно, решит проблему. Альтернативная практическая стратегия ограничения количества единиц передачи знаний, когда система развивается во времени, состоит в том, чтобы сохранить только наиболее релевантные из них с учетом приемлемых показателей производительности и размера «релевантного» множества S. Связь между ними является предусмотрены в теоремах 1, 2. С другой стороны, если увеличение количества единиц передачи знаний или отклонение менее актуальных по какой-либо причине нежелательно, то двухфункциональные единицы могут быть возможным решением.Алгоритм 2 представляет процедуру такой улучшенной передачи знаний AI.

Далее мы проиллюстрируем подход, а также применение предложенных алгоритмов передачи знаний в актуальной задаче проектирования системы компьютерного зрения для обнаружения пешеходов в видеопотоках в реальном времени.

3. Пример

Пусть AI s и AI t будут двумя системами, разработанными, например, для целей обнаружения пешеходов в видеопотоках в реальном времени.Технологический прогресс во встроенных системах и доступность таких платформ, как Nvidia Jetson TX2, сделали возможным аппаратное развертывание таких систем искусственного интеллекта на границе конвейеров обработки компьютерного зрения. Однако этим платформам не хватает вычислительной мощности, которая позволила бы запускать в реальном времени самые современные решения для обнаружения крупномасштабных объектов, такие как ResNet (He et al., 2016). Сверточные нейронные сети меньшего размера, такие как SqueezeNet (Iandola et al., 2016), могут стать способом продвижения вперед. Тем не менее, эти последние системы имеют сотни тысяч обучаемых параметров, которые обычно на несколько порядков больше, чем в e.г., гистограммы систем на основе ориентированных градиентов (HOG) (Dalal and Triggs, 2005). Более того, обучение этих сетей требует значительных вычислительных ресурсов и данных.

В этом разделе мы проиллюстрируем применение предлагаемой технологии передачи знаний AI и продемонстрируем, что эту технологию можно успешно использовать для компенсации недостатка мощности периферийного устройства. В частности, мы предлагаем, чтобы система на основе границ «обучалась» современным учителем в неитеративном режиме и в режиме, близком к реальному времени.Поскольку наши строительные блоки являются линейными функционалами, такое обучение не приведет к значительным вычислительным затратам. В то же время, как мы покажем позже, предлагаемая передача знаний AI приведет к значительному повышению производительности системы в условиях эксперимента.

3.1. Определение

AI s и AI t и обоснованиеВ наших экспериментах учитель AI, AI t , был смоделирован с помощью адаптации SqueezeNet (Iandola et al., 2016) с обучаемыми параметрами около 725 К. Сеть была обучена на наборе данных «учителя», состоящем из 554 тыс. Непешеходных (негативных) и 56 тыс. Пешеходных (позитивных) изображений. Позитивы затем подвергались стандартному увеличению с учетом различных геометрических и цветовых отклонений. Сеть была обучена в течение 100 эпох, что на Nvidia Titan Xp заняло около 16 часов. AI ученика, AI s , был смоделирован с помощью линейного классификатора с функциями HOG (Dalal and Triggs, 2005) и обучаемыми параметрами 2016.Значения этих параметров были результатом обучения AI s на наборе данных «ученик», подвыборке набора данных «учитель», состоящей из 16 K положительных результатов (55 K после увеличения) и 130 K отрицательных результатов. , соответственно. Выбор систем AI s и AI t позволил нам имитировать взаимодействие между маломощными периферийными ИИ и их более мощными аналогами, которые могут быть развернуты во встроенных системах с более высокими характеристиками. или, возможно, на сервере или в вычислительном облаке.

Отметим, что как для AI t , так и для AI s набор негативов в несколько раз больше, чем набор позитивов. Это делает наборы данных несколько несбалансированными. Несбалансированные наборы данных не редкость в задачах обнаружения объектов. Есть несколько причин, по которым такие несбалансированные наборы данных могут возникать на практике. Каждый кандидат на включение в набор положительных результатов обычно подвергается тщательной проверке со стороны человека. Это делает процесс трудоемким и дорогостоящим и, как следствие, накладывает ограничения на достижимый размер набора.Негативы, как правило, создавать легче. Отметим также, что набор негативов в наших экспериментах — это, по сути, набор всех объектов, не являющихся пешеходами. Этот последний набор имеет значительно более широкий спектр вариаций, чем набор позитивов. Учет этой большей изменчивости без навязывания каких-либо дополнительных предварительных предположений или знаний может быть достигнут с помощью более крупных выборок. Это была стратегия, которую мы здесь приняли.

Для большей реалистичности эксперимента мы предположили, что внутренние состояния обеих систем недоступны для прямого наблюдения.Для создания наборов S и Y, требуемых в алгоритмах 1 и 2, мы дополнили систему AI s внешним генератором функций HOG той же размерности. Мы предположили, однако, что положительные и отрицательные стороны набора данных «студент» доступны для целей передачи знаний. Схема, представляющая эту установку, показана на рисунке 4. Изображение кандидата оценивается двумя системами одновременно, а также генератором признаков HOG. Последний генерирует 2016 размерных векторов HOG и сохраняет эти векторы в наборе S.Если выходы AI s и AI t не совпадают, то соответствующий вектор признаков добавляется в набор Y.

Рисунок 4 . Схема передачи знаний между ИИ учителя и ИИ ученика, дополненная генератором функций на основе HOG.

3.2. Типы исправленных ошибок

В этом эксперименте мы рассматриваем и устраняем два типа ошибок: ложные срабатывания (исходные ошибки типа I) и ложноотрицательные (исходные ошибки типа II).Типы ошибок определялись следующим образом. Ошибка считается ложным срабатыванием (для исходных данных), если AI s сообщил о наличии полноразмерного изображения пешехода правильного размера на данном участке изображения, тогда как такого объекта там не было. Точно так же ошибка считается ложноотрицательной (для исходных данных), если пешеход присутствовал в данном фрагменте изображения, но AI s не сообщил об этом там.

Нашей основной задачей было воспроизвести сценарий развертывания, в котором AI t способен одновременно оценивать только небольшие участки изображения в заданных квантах обработки. В то же время AI s должен уметь обрабатывать весь кадр за разумное время, но его точность ниже. Это делает оценку всех соответствующих изображений с помощью AI t нецелесообразным с вычислительной точки зрения и, кроме того, исключает автоматическое обнаружение ошибок типа II (исходные ложные негативы), когда AI s сканирует изображение в тысячах позиций в кадре.С другой стороны, количество положительных ответов AI s ограничено несколькими десятками фрагментов меньшего размера на кадр, что, как предполагается, находится в пределах возможностей обработки AI t . Ввиду этих соображений мы поэтому сосредоточили внимание в основном на ошибках типа I (исходные ложные срабатывания). Тем не менее, в разделе 3.4 мы обсуждаем возможные способы обработки ошибок типа II в исходной системе и приводим иллюстративный пример того, как это можно было бы сделать.

Стоит отметить, что выходные метки выбранного AI учителя, AI t , не всегда совпадают с наземными метками. AI t тоже может давать случайные ошибки, и примеры таких ошибок представлены на рис. 5. Независимо от них, производительность AI t была заметно выше, чем у AI s и, следовательно, ради тестирования концепции, эти редкие случайные ошибки AI t были отброшены в экспериментах.

Рисунок 5 . Примеры ложных срабатываний, сгенерированных учителем AI, AI t , для видео NOTTINGHAM (Burton, 2016).

3.3. Наборы данных, используемые в экспериментах, и типы экспериментальных ошибок

Для тестирования подхода мы использовали видео NOTTINGHAM (Burton, 2016), содержащее 435 кадров живого видео, снятого с помощью экшн-камеры. Видео, по данным ручного осмотра, содержит 4039 полноразмерных изображений пешеходов.

В целях обучения и тестирования модулей передачи знаний видео было передано через AI s и AI s , возвращенные обнаруженные фигуры пешеходов.Эти обнаружения были оценены с помощью AI t и помечены соответствующим образом (см. Диаграмму на рисунке 4). На этом этапе порог принятия решения в AI s варьировался от -0,3 до 2 для захвата достаточно большой выборки ложных срабатываний, оценки которых близки к границе принятия решения. Этот помеченный набор векторов признаков был разделен на два неперекрывающихся подмножества: набор 1, состоящий примерно из 90% истинно положительных и 90% ложных срабатываний, и набор 2, являющийся его дополнением.Характеристики HOG, соответствующие исходным ошибкам типа I (ложные срабатывания) в наборе 1, а также все функции HOG, извлеченные из 55 тыс. Изображений положительных результатов, которые использовались для обучения AI s были объединены в обучающий набор . Этот обучающий набор затем был использован для получения единиц передачи знаний для AI s .

Наборы 1 и 2 составляют разные наборы для тестирования в нашем примере. Первый набор тестов (Набор 1) позволяет нам оценить, как модифицированный AI s справляется с удалением «видимых» исходных ошибок I типа (ложных срабатываний) при наличии «невидимых» истинных срабатываний.Второй набор тестирования (набор 2) будет использоваться для оценки возможностей обобщения окончательной системы.

Отметим, что маркировка ложных срабатываний касалась выходов AI t , а не наземных меток истинности. Визуальный осмотр этикеток AI t показал, что они также содержат несколько десятков ложных срабатываний. Это число, однако, ничтожно мало по сравнению с общим количеством истинных положительных результатов (около 2000) и ложных срабатываний (около 800) ИИ ученика, AI s .

Наконец, для количественной оценки эффективности предлагаемого подхода к передаче знаний важно различать определения типов ошибок (Тип I и Тип II) для исходной системы и типы ошибок, характеризующие производительность самих модулей передачи знаний . Соответствующие определения приведены в Таблице 1. Обратите внимание, что истинных негативов (отмеченных звездочкой * в таблице) в экспериментах не наблюдается. В следующих случаях и если не указано иное, мы будем ссылаться на эти определения.

Таблица 1 . Определение типов ошибок в экспериментах по передаче знаний.

Результаты применения алгоритмов 1, 2, а также анализ их производительности на тестовых наборах представлены ниже.

3.4. Результатов

Мы сгенерировали 10 различных реализаций наборов 1 и 2. В результате получили 10 различных образцов обучающих и тестовых наборов. Алгоритмы были применены ко всем этим различным комбинациям. Один прогон этапа предварительной обработки Шаг 1 занял в среднем 23 раза.5 с для ноутбука Apple с процессором A7 3,5 ГГц. После этапа предварительной обработки было сохранено только 164 основных компонента. Это привело к значительному уменьшению размерности векторов признаков. В наших экспериментах предварительная обработка также включала нормализацию отбеленных векторов так, чтобы их норма L 2 всегда была единица. Это переносит данные на единичную сферу, что несколько больше согласуется с теоремами 1 и 2. Шаги 2 в алгоритмах 1, 2 заняли 1 и 24 мс соответственно.Это значительное ускорение по сравнению с полным переобучением AI с (несколько минут) или AI t (часы). Также обратите внимание, что полное повторное обучение не дает никаких гарантий того, что ошибки будут устранены.

Перед запуском шагов 2 алгоритмов мы проверили, коррелированы ли векторы признаков, соответствующие ошибкам (ложным срабатываниям) в обучающем наборе. Это позволяет осознанный выбор параметра количества кластеров, p , в алгоритмах 1 и 2.Трехмерная цветная визуализация корреляций, то есть 〈 x i , x j 〉 между предварительно обработанными (после шага 1) элементами в наборе Y: показано на рисунке 6, левая панель. Гистограмма длин всех векторов обучающего набора показана на рисунке 6, правая панель. Обратите внимание, что длины аккуратно концентрируются около 164, как и ожидалось. Согласно рисунку 6, элементы множества Y в большинстве своем некоррелированы.Однако есть несколько коррелированных элементов, которые, как мы ожидаем, будут учтены на шаге 2.a алгоритмов. В отсутствие заметно распространенных корреляций мы устанавливаем p = 30, что эквивалентно примерно 25 элементам на кластер. Примеры корреляций внутри кластеров после завершения шага 2 показаны на рисунке 7. Обратите внимание, что чем больше порог, тем выше ожидаемая корреляция между элементами и тем выше шансы, что такой блок передачи знаний будет работать успешно (см. Теоремы 1 и 2).

Рисунок 6. (Слева) : Диаграмма корреляции между элементами набора Y (элементы, которые должны быть изучены с помощью AI s ). (справа) : Гистограмма длин векторов признаков в обучающем наборе после предварительной обработки.

Рисунок 7 . Корреляции внутри кластеров после этапа 2. Левая панель соответствует кластеру с большим порогом ≃0,76. Правая панель соответствует кластеру с нижним порогом ≃0.43.

Производительность алгоритмов 1, 2 на тестовых наборах, сгенерированных из видео NOTTINGHAM, представлена на рисунках 8, 9. На этих рисунках мы показали поведение

. Точность = Истинные положительные результаты + Ложные положительные результаты Повторный вызов = Истинные положительные результаты Истинные положительные результаты + Ложные отрицательные результаты,как функции порога принятия решения в диаграммах AI s , Precision-Recall и True Positives vs. Красные кружки соответствуют исходному AI s без блоков передачи знаний.Синие квадраты соответствуют AI s после алгоритма 1, а зеленые треугольники иллюстрируют применение алгоритма 2. Обратите внимание, что максимальное количество ложных срабатываний на рисунке 8 не превышает 400. Это связано с тем, что порог был теперь установлен. варьируется в рабочем интервале [0, 2] в отличие от [-0,3, 2], используемого для сбора обучающих данных.

Рисунок 8 . Производительность обученного AI s на испытательном наборе 1 (набор 1).Красные кружки соответствуют исходному AI s без блоков передачи знаний. Синие квадраты соответствуют AI s после алгоритма 1, а зеленые треугольники иллюстрируют применение алгоритма 2. (A) показывает точность (усредненную по 10 реализациям набора 1) как функцию порога принятия решения в AI s , (B) показывает отзыв (усредненное по 10 реализациям набора 1), (C) содержит соответствующие данные точного вызова, а (D) показывает истинные положительные результаты по сравнению сЛожные срабатывания для одной реализации набора 1. Линии между точками показаны для наглядности и не представляют никаких измерений и не указывают на достижимую производительность.

Рисунок 9 . Производительность обученного AI s на испытательном наборе 2 (набор 2). Красные кружки соответствуют исходному AI s без блоков передачи знаний. Синие квадраты соответствуют AI s после алгоритма 1, а зеленые треугольники иллюстрируют применение алгоритма 2. (A) показывает точность (усредненную по 10 реализациям набора 2) как функцию порога принятия решения в AI s , (B) показывает отзыв (усредненный по 10 реализациям набора 2), (C) содержит соответствующие данные Precision-Recall, а (D) показывает истинные положительные результаты по сравнению с ложными срабатываниями для одной реализации набора 2. Линии между точками показаны для визуализации и не представляют никаких измерений. или указать достижимую производительность.

Как показано на рисунке 9, производительность AI s на испытательном наборе 1 (набор 1) резко улучшается после применения обоих алгоритмов. Алгоритм 2 превосходит алгоритм 1 с некоторым запасом, что наиболее заметно на графике на рисунке 8D. Почти идеальная производительность в пространстве Precision-Recall можно объяснить тем, что обучающая выборка содержала полную информацию о ложных срабатываниях (но не о настоящих срабатываниях). Важно отметить, что алгоритм 2 не помечает почти все «невидимые» истинные положительные результаты.

Что касается результатов, показанных на рисунке 9, характеристики производительности AI s после применения обоих алгоритмов изменяются. Алгоритм 1 приводит к незначительному снижению показателей отзыва, а алгоритм 2 восстанавливает это падение до базовой производительности. Точность незначительно улучшается для обоих алгоритмов, а кривые истинных положительных и ложных срабатываний для AI с с блоками передачи знаний преобладают над кривыми простого AI с .Это говорит о том, что предлагаемая структура передачи знаний не только позволяет приобретать новые знания, как указано в помеченных данных, но также обладает способностью к дальнейшему обобщению знаний. Степень такого обобщения, очевидно, будет зависеть от статистики данных. Тем не менее, как показано на рисунке 9, это вполне реальная возможность.

Наши эксперименты показали, как этот подход может быть использован для фильтрации ошибок типа I в исходной системе. Однако эту технологию можно использовать и для восстановления ошибок типа II (ложноотрицательные результаты в исходной системе), если данные будут доступны.Для получения этих данных можно использовать несколько стратегий. Первый подход заключается в использовании вычитания фона для обнаружения движущегося объекта и пропускания объекта через AI s и AI t . Второй подход состоит в том, чтобы позволить AI s сообщать об обнаружениях, которые классифицируются как отрицательные, но все же находятся достаточно близко к границе обнаружения. Это стратегия, которую мы здесь приняли. Мы проверили характеристики HOG в AI s , соответствующие значениям в интервале [-0.3, 0] с учителем AI, AI t . Всего этим методом было выделено 717 векторов HOG, из которых 307 были помечены AI t как положительные, а 410 считались отрицательными. Мы взяли один из векторов признаков HOG, помеченных как True Positive, x v , и построили (после применения преобразования предварительной обработки из предыдущих экспериментов) несколько разделяющих гиперплоскостей с весами x v / || x v || и пороги c v , изменяющиеся в [0, 1].Результаты сведены в Таблицу 2. Как и раньше, мы наблюдаем сильный эффект концентрации меры: блок передачи знаний демонстрирует крайнюю избирательность для достаточно больших значений c v . В данном конкретном случае c v = 0,25 обеспечивает максимальный выигрыш при минимальном риске ожидаемой ошибки в будущем [см. например, правая часть (1) в теореме 1 при k = 1, ε = 0,75 для оценки].

Таблица 2 .Восстановление ошибок типа II исходного AI s .

4. Заключение

В этой работе мы предложили структуру для мгновенной передачи знаний между системами ИИ, внутреннее состояние которых, используемое для принятия решений, может быть описано элементами многомерного векторного пространства. Платформа позволяет разрабатывать неитеративные алгоритмы для распространения знаний между унаследованными системами ИИ с разнородными неидентичными архитектурами и различными вычислительными возможностями.Реализуемость структуры была проиллюстрирована на примере передачи знаний между двумя системами ИИ для автоматического обнаружения пешеходов в видеопотоках.

В основе предлагаемой структуры передачи знаний лежат теоремы разделения (теорема 1–3), устанавливающие особые свойства больших, но конечных случайных выборок в высокой размерности. Согласно этим результатам, k < n случайных i.i.d. элементы могут быть разделены на M ≫ n случайно выбранных элементов i.я бы. выборка из одного и того же распределения несколькими линейными функционалами с высокой вероятностью. Теоремы доказаны для равнораспределений в шаре и кубе. Результаты можно тривиально обобщить на эквираспределения в эллипсоидах и гауссовские распределения. Подробное обсуждение этих вопросов выходит за рамки и видение данной работы. Тем не менее, обобщения для других значимых распределений, ослабление требования независимости и более широкий взгляд на то, как предлагаемую технологию можно использовать в многоагентных системах ИИ, представлены в техническом отчете (Gorban et al., 2018).

Авторские взносы

Все перечисленные авторы внесли существенный, прямой и интеллектуальный вклад в работу и одобрили ее к публикации.

Финансирование

Работа поддержана Минобрнауки России (проект № 14.Y26.31.0022) и Innovate UK (грант Партнерства по передаче знаний KTP010522).

Заявление о конфликте интересов

KS использовался в ARM Holding, а IR — в Spectral Edge Ltd.На момент подготовки рукописи IR работал в ARM Holding. Все данные, использованные в экспериментах, предоставлены АРМ Холдингом.

Остальные авторы заявляют, что исследование проводилось при отсутствии каких-либо коммерческих или финансовых отношений, которые могли бы быть истолкованы как потенциальный конфликт интересов.

Список литературы

Бухтала О. и Больной Б. (2007). «Базовые технологии передачи знаний в интеллектуальных системах», симпозиум IEEE по искусственной жизни, 2007 г.ALIFE’07 (Гонолулу, Гавайи), 251–258.

Бусила К., Каруана Р. и Никулеску-Мизил А. (2006). «Сжатие модели», в KDD (Филадельфия, Пенсильвания: ACM), 535–541.

Бертон, Р. (2016). Ноттингем видео. Тестовое видео для обнаружения пешеходов, снятое с улиц Ноттингема камерой действия . Доступно в Интернете по адресу: https://youtu.be/SJbhOJQCSuQ

Чен Т., Гудфеллоу И. и Шленс Дж. (2015). Net2net: ускорение обучения за счет передачи знаний. arXiv [препринт]. arXiv: 1511.05641 .

Google Scholar